ChatGPTやClaudeなどの生成AIサービスは、学習データや回答生成のためにWebサイトを巡回するクローラーを稼働させています。このAIクローラーへの対応は、サイト運営者によって受け入れるか拒否したいか意見が分かれるところです。

「コンテンツを無断でAI学習に使われたくない」という方もいれば、「AI検索に自サイトを引用させてコンテンツの露出を増やしたい」という方もいます。どちらの立場も正当な考え方であり、あなたのサイトの方針に合わせて設定を選ぶことができるのです。

ブロックしたい方の主な理由:

- コンテンツを無断でAI学習に使われたくない

- サーバーへの余計な負荷を減らしたい

- 著作権・情報管理の観点から制御したい

許可したい方の主な理由:

- PerplexityなどのAI検索に自サイトを引用させたい

- AIエージェントにサイトを活用してもらいたい

- コンテンツの露出機会を増やしたい

この記事では、ロリポップ!レンタルサーバーのWordPressサイトで、AIクローラーの許可・拒否を目的に応じて設定する方法を紹介します。

主なAIクローラー一覧

設定前に、対象となるクローラーを把握しておきましょう。

| クローラー名 | 運営元 | 用途 |

|---|---|---|

| GPTBot | OpenAI | ChatGPT学習・回答生成 |

| Google-Extended | GeminiなどAI製品向け | |

| ClaudeBot | Anthropic | Claude学習・回答生成 |

| PerplexityBot | Perplexity | AI検索エンジン |

| Applebot-Extended | Apple | Apple Intelligence向け |

| Amazonbot | Amazon | Alexaなど向け |

なお、Googlebotなどの通常の検索用クローラーはこれらとは別物です。AIクローラーだけをブロックしても、検索エンジンの順位には影響しません。

AIクローラーをコントロールする方法

ロリポップのWordPressサイトでAIクローラーをコントロールする方法は、主に3つです。

- robots.txt:標準的な方法。クローラーごとに許可・拒否を細かく設定できる

- .htaccess:サーバーレベルでブロック。より強力にブロックしたい場合に追加する

- WordPressプラグイン:WordPress管理画面内で簡単に管理したい場合に使う

まずは robots.txt での設定から始めて、必要に応じて .htaccess を組み合わせるのがおすすめです。自分のサイトの方針に合わせて、許可・拒否を使い分けてみてください。順番に詳しく説明していきます。

【基本】設定方法① robots.txt で制御する

もっとも標準的な方法です。サイトルートに置く robots.txt にルールを記述します。

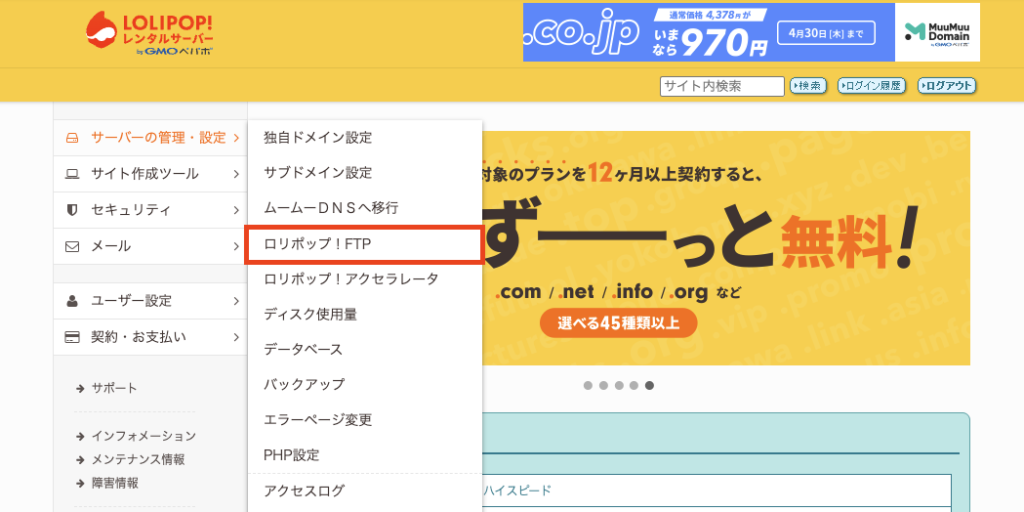

ロリポップでの編集方法

テキストエディターで robots.txt を作成し、FTPソフトを使用してサイトルートにアップロードします。ロリポップのユーザー専用ページから操作する場合、サーバーの管理・設定 → ロリポップ!FTP からログインし、サイトルートに robots.txt をアップロードします。サイトの制作環境によってはすでに robots.txt が存在している場合もありますので、その際には下記の内容を追加するとよいでしょう。

すべてのAIクローラーをブロックする場合の robots.txt

# AIクローラーをまとめてブロック

User-agent: GPTBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: PerplexityBot

Disallow: /

User-agent: Applebot-Extended

Disallow: /

User-agent: Amazonbot

Disallow: /

# 通常の検索クローラーは許可

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

クローラーごとに細かく設定する場合の robots.txt 例

特定のAIだけ許可・拒否することもできます。

# OpenAIはブロック、Perplexityは許可

User-agent: GPTBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: PerplexityBot

Allow: /

# 通常の検索クローラーは許可

User-agent: Googlebot

Allow: /

特定のディレクトリーだけ除外したい場合の robots.txt 例

コンテンツ全体はクローラーを許可しつつ、会員向けページ(/member/)や特定カテゴリー(/private/)だけクローラーからブロックしたい場合の記述例です。

User-agent: GPTBot

Disallow: /member/

Disallow: /private/

Allow: /

【強力】設定方法② .htaccess を設置してサーバーレベルでブロックする

robots.txt はあくまでクローラーへのお願いであり、悪意あるボットは無視する場合があります。より強力にブロックしたい場合は .htaccess を設置することでサーバーレベルでブロックすることができます。ただし、User-Agentは偽装が可能なため、悪意あるボットへの完全な対策にはならない点についてはご注意ください。

方法は、ロリポップ!FTPかFTPソフトで、サイトルートの .htaccess を開いて以下を追記します。なお、.htaccess の編集はサイト全体に影響します。編集前に必ずバックアップを取ってください。

# AIクローラーをサーバーレベルでブロック

SetEnvIfNoCase User-Agent "GPTBot" block_ua

SetEnvIfNoCase User-Agent "Google-Extended" block_ua

SetEnvIfNoCase User-Agent "ClaudeBot" block_ua

SetEnvIfNoCase User-Agent "PerplexityBot" block_ua

SetEnvIfNoCase User-Agent "Applebot-Extended" block_ua

SetEnvIfNoCase User-Agent "Amazonbot" block_ua

SetEnvIfNoCase User-Agent "CCBot" block_ua

SetEnvIfNoCase User-Agent "Meta-ExternalAgent" block_ua

<RequireAll>

Require all granted

Require not env block_ua

</RequireAll>

【簡単】設定方法③ WordPressプラグイン使って管理する

コードを直接編集したくない場合は、プラグインを使って管理できます。コードの書き方を覚えなくてよいので、はじめての方にはこちらがおすすめではないでしょうか。

「Block AI Crawlers」プラグイン

「Block AI Crawlers」プラグインをインストールすると、チェックボックスでクローラーごとのオンオフを切り替えるだけで、許可・拒否の設定の変更が手軽にできます。

- メリット: robots.txt の書き方を覚えなくてよく、設定の変更が簡単

- デメリット:プラグインを介した robots.txt への書き込みのため、悪質なボットには効かない場合がある

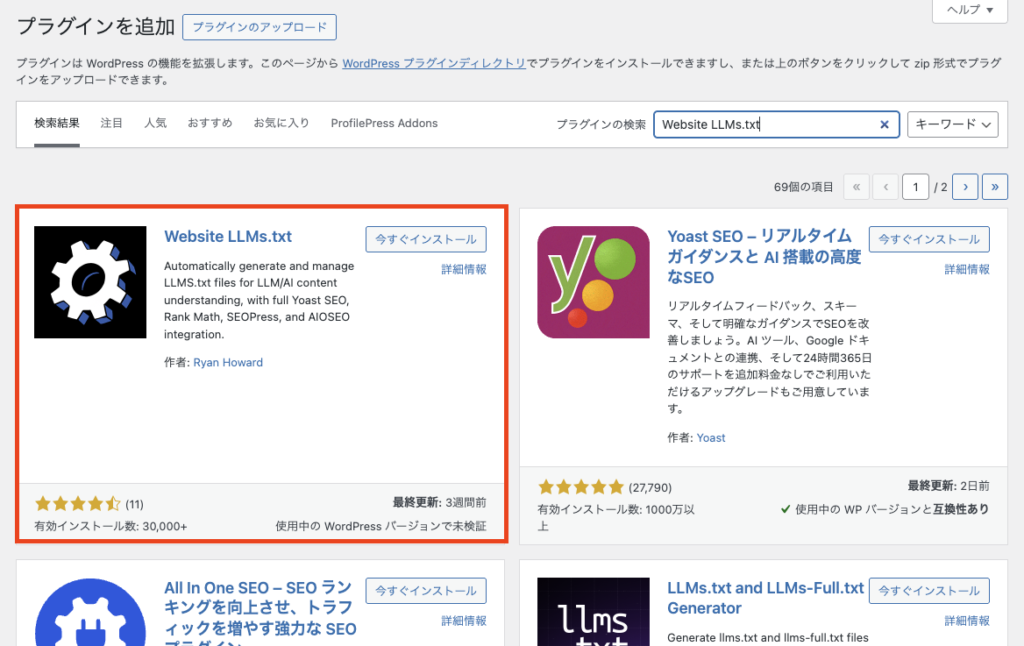

「Website LLMs.txt」プラグイン

「Website LLMs.txt」プラグインをインストールすると、WordPress管理画面から llms.txt を生成・設定できます。 llms.txt はAIクローラー向けのサイトインデックスファイルです。このファイルを設置することで、AIに「どのページを参照してよいか」をより細かく伝えられます。以下は llms.txt の例です。

# example.com

> このサイトはプログラミングに関する情報を提供しています。

## 公開コンテンツ(AI参照可)

- 記事一覧: ブログ記事

- ツール紹介: 便利ツールの紹介

## 除外コンテンツ

- /member/ : 会員限定コンテンツ(参照不可)

なお、llms.txt はまだ標準仕様として広く採用されているわけではなく、対応しているAIクローラーは限られます。あくまで補助的な情報提供の手段として位置づけてください。

設定の組み合わせ例

目的に合わせて、3つの設定を組み合わせて使うことができます。

| 目的 | robots.txt | .htaccess | llms.txt |

|---|---|---|---|

| 完全にブロックしたい | 全クローラー Disallow | ブロック設定を追加 | 不要 |

| AI検索には出たい・学習には使わせたくない | 学習系のみ Disallow | 任意 | 設置する |

| すべて許可してAI-Readyにしたい | 全クローラー Allow | 設定不要 | 設置する |

| クローラーごとに使い分けたい | 個別に設定 | 任意 | 設置する |

設定前に知っておきたい注意点

robots.txt は強制力を持ちません。 倫理的なクローラーは遵守しますが、すべてのボットが守るとは限りません。確実に遮断したい場合は .htaccess を併用してください。

クローラーはサイトを定期的に巡回するため、設定変更は即時反映されません。設定変更後も既存のデータが即座に削除されるわけではありません。

GPTBotなどのAIクローラーをブロックしても、GooglebotやBingbotは別物なので検索エンジンの順位には影響しません。

まとめ

AIクローラーをどう扱うかは、「コンテンツをどう活かしたいか」という運営者側の方針によって変わります。学習には使わせたくないが、AI検索での引用は歓迎したい、そんな細かいコントロールも今回紹介した方法を組み合わせれば実現できます。

AIクローラーへの対応は、今後のWebサイト運営においてますます重要になっていくテーマです。ロリポップでつくっているWebサイトは、今回紹介したいずれの方法もすぐに試すことができます。自分のサイトに合ったコントロール方法を見つけて、コンテンツを管理していきましょう。